MÁS INTELIGENTES

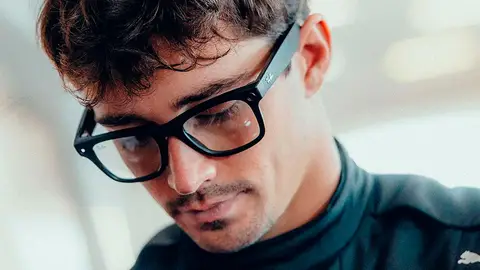

La Ray-Ban de Meta estrenan nuevas funciones de IA y ahora también cazan canciones

Las gafas de Meta estrenan ahora un modo de conversación en vivo con la IA, mucho más natural, junto a otras importantes novedades.

Publicidad

No cabe duda de que Meta ha conseguido poco a poco, y haciendo el mínimo ruido posible, consolidarse como uno de los líderes indiscutibles en el mercado de gafas inteligentes, desde las sofisticadas Meta Quest, hasta las casuales y perfectas para vestir Ray-Ban. Estas últimas son el mejor ejemplo de que una gafa puede ser sencilla y corriente a la par de inteligente. Unas gafas que siguen mejorando con nuevas actualizaciones, que están mejorando sin duda alguna todo lo que nos pueden ofrecer en el día a día, como en su última actualización.

Shazam y otras novedades para las Ray-Ban

Ha sido la propia Meta quien ha anunciado las novedades que llegan con el fin de año a las gafas de la marca. Una de las novedades más interesantes la encontramos sin duda alguna en la integración de Shazam en las gafas de Meta. Con ella, ahora es posible cazar una canción con tan solo pedírselo a las gafas. Para ello solo tendremos que decir que Hey Meta, ¿cuál es esta canción? Para que comiencen a hacer el reconocimiento del sonido de ambiente en busca de una canción.

Como es habitual en Shazam, la aplicación buscará en su base de datos el clip de audio grabado por las gafas para encontrar coincidencias con los millones de canciones que están guardadas en su base de datos. Eso sí, de momento esta nueva funcionalidad solo está disponible en Estados Unidos y Canadá para los usuarios de estas gafas, es de esperar que hagan lo propio en otras regiones más adelante.

Pero hay más, porque con esta actualización también tenemos una nueva ración de inteligencia artificial. Y es que con la función de IA en vivo vamos a poder disfrutar de una IA que está constantemente atenta a lo que ocurre delante de nosotros. Y lo más importante, como en el caso de los modelos de AI de OpenAI y Google, ahora tenemos un modo de conversación continua, natural y fluida. En este modo podemos hacer todo tipo de preguntas, encadenar unas detrás de otra sin necesidad de estar comenzando las conversaciones con Hey Meta.

Lo mismo ocurre con la nueva función de traducción en vivo. Esta nos permite como su nombre indica, hacer traducciones de diferentes idiomas. Concretamente, podremos hacer traducciones en tiempo real entre el inglés, español, francés e italiano. Las gafas, al escuchar que alguien nos habla en uno de estos idiomas, traducirá de manera automática estas palabras a través de los auriculares integrados en las patillas de las gafas. Vamos, que podremos entender de lo que nos hablan, incluso si no tenemos idea de ese idioma.

De momento, estas funciones de IA están disponibles para aquellos usuarios que quieran probarlas de manera preliminar. Aunque una vez más es algo limitado a los usuarios de Estados Unidos y Canadá. Meta ha emplazado a los usuarios de estas gafas a descubrir durante 2025 nuevas actualizaciones de software e incluso algunas sorpresas, que esperemos, signifiquen nuevas versiones de estas gafas, que sin duda están ganando poco a poco mucha popularidad en el mercado.

Publicidad