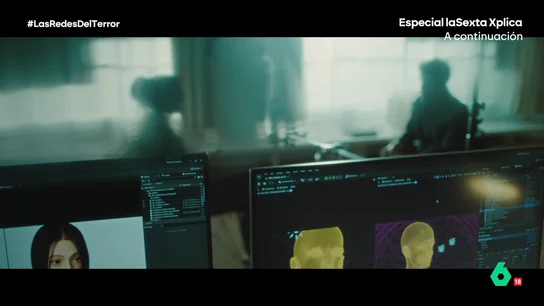

Detrás está su modelo de negocio

Salvados se adentra en la fábrica del terror que suponen las redes sociales en un especial en el que se indaga en los peligros de aplicaciones que todos usamos en nuestro día a día. El programa cuenta con la intervención de Arturo Béjar, ex directivo de Facebook que revela cómo la plataforma ignoró los daños a sus usuarios y obligó a Mark Zuckerberg a pedir disculpas públicas. Trabajadores y moderadores de contenido desvelan que se pueden encontrar decapitaciones, pornografía, mutilaciones, torturas y suicidios de adolescentes, y confiesan que se puede ver "el mal encarnado en las redes". Lo mejor del programa de Salvados sobre las redes sociales, en laSexta.

Detrás está su modelo de negocio

Un 20% de la plantilla, de baja

"Se genera un trauma"

"Acabé corriendo y llorando"

"El peor oficio del mundo"

Tras participar en Salvados

"En la vida había visto una cosa igual"

"Crees que no te afecta, pero es mentira"

"Lo más fuerte te pilla por sorpresa"

Entrevista en Salvados

"Me estaba mareando"

Exdirectivo de Facebook

Tras su investigación en Salvados

"Un lugar donde se enferma gente"

"Sufría ataques de ansiedad aguda"

Estremecedor relato en Salvados

Enfermar por moderar contenido

Las secuelas de moderar contenido